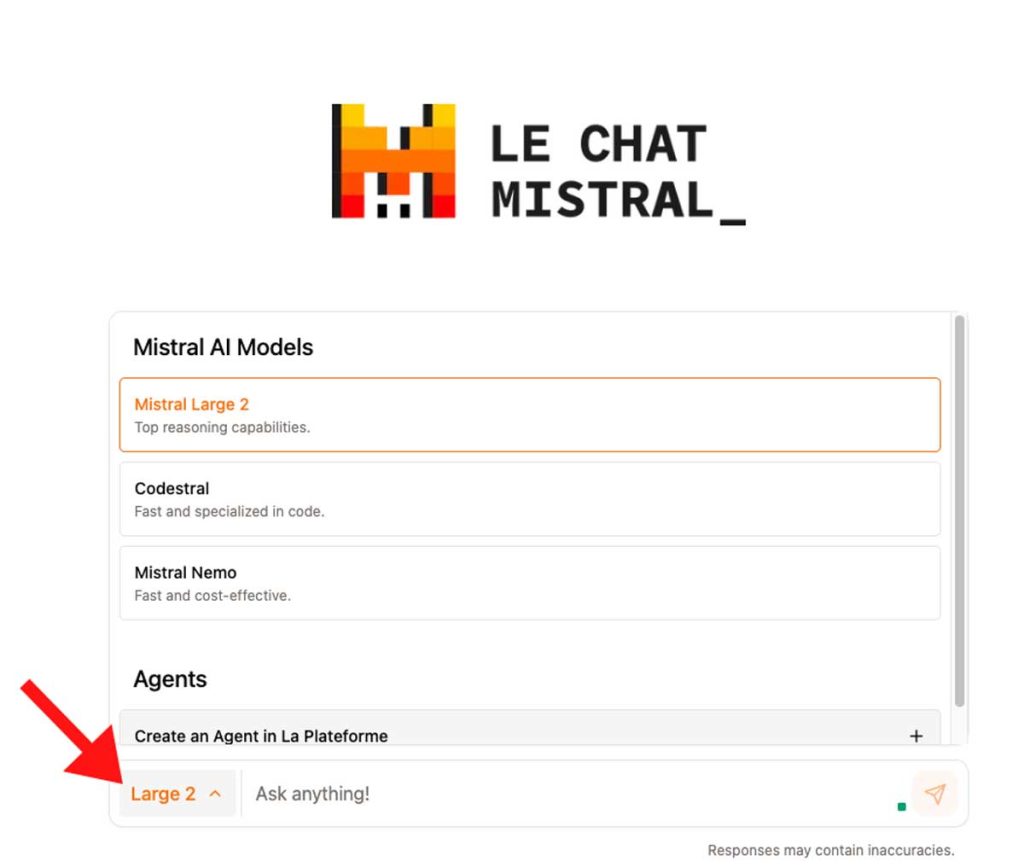

Via le Chat : la façon la plus simple

Pour utiliser Mistral AI via un interface de chat, rendez-vous sur la partie le Chat du site de Mistral AI.

Si vous n’avez pas de compte, vous devrez alors en créer un. (Via Google, Microsoft, ou avec votre email).

Une fois connecté, vous pouvez maintenant accéder à le Chat. Cette interface vous permet de dialoguer avec l’un des 3 modèles IA proposé par Mistral AI, à savoir :

- Mistral Large 2 (que nous avons analysé en détail ici)

- Codestral

- Mistral Nemo

Comparatif des différents modèles de Mistral AI

Ces modèles sont accessibles gratuitement mais avec des limitations de messages par jour.

| Nom | Description | Fenêtre token |

|---|---|---|

| Mistral Nemo | Modèle 12B de pointe, multilingue, sous licence Apache 2.0 | 128K tokens |

| Mistral Large 2 | Modèle avancé pour tâches complexes, multilingue, avec fonction calling | 128K tokens |

| Codestral | Spécialisé en programmation, optimisé pour faible latence | 32K tokens |

Via l’API de Mistral AI, pour les développeurs

L’API comporte certains modèles en plus comme Mistral Embed, et les « Research models ». Vous pouvez retrouver la liste des noms et les caractéristiques de ces modèles ici.

| Modèle | Nom API | Description | Entrée | Sortie |

|---|---|---|---|---|

| Mistral Nemo | open-mistral-nemo-2407 | Mistral Nemo est un modèle 12B à la pointe de la technologie développé avec NVIDIA. | 0,3 $ /1M tokens | 0,3 $ /1M tokens |

| Mistral Large 2 | mistral-large-2407 | Raisonnement de haut niveau pour des tâches très complexes, pour vos besoins les plus sophistiqués. | 3 $ /1M tokens | 9 $ /1M tokens |

| Modèles spécialisés | ||||

| Codestral | codestral-2405 | Modèle Mistral à la pointe de la technologie, spécifiquement entraîné pour les tâches de programmation. | 1 $ /1M tokens | 3 $ /1M tokens |

| Mistral Embed | mistral-embed | Modèle sémantique de pointe pour l’extraction de représentations d’extraits de texte. | 0,1 $ /1M tokens | – |

Laisser un commentaire